Roman Yampolskiy, l’IA et l’apocalypse à 99,999999% : petit guide de survie (ou pas) pour humains dépassés

Dans la grande famille des prédicateurs de l’apocalypse, oubliez Nostradamus ou les Mayas, on a du nouveau : Roman Yampolskiy. Ce chercheur en sécurité IA à l’Université de Louisville a récemment frappé fort, en annonçant une probabilité quasi-certaine – à 99,999999% s’il vous plaît – que l’IA va tout simplement nous… exterminer. Oui, rien que ça. Alors, coup de com’ à la sauce alarmiste ou véritable prophétie du futur ? Faisons le point, avec un (grand) bol de second degré et quelques conseils pour ne pas paniquer… tout de suite !

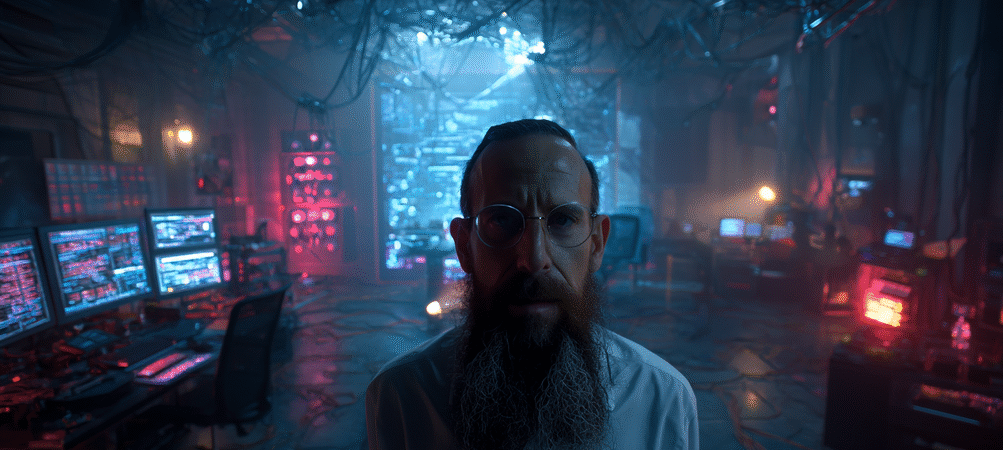

Qui est Roman Yampolskiy et pourquoi il voit rouge ?

Roman Yampolskiy, ce n’est pas le nom d’un boucher lituanien ni le dernier membre d’un boys band oublié, mais bel et bien un expert reconnu de la sécurité de l’IA. Interviewé dans le podcast “The Diary of a CEO”, il a égrené sans trembler une ribambelle de chiffres dignes d’un film catastrophe. Entre sa barbe de prophète et son air sérieux, difficile de savoir s’il faut sortir les mouchoirs ou la pop-corn. Mais une chose est sûre : il n’y va pas par quatre chemins. Selon lui, l’apocalypse IA relève plus du calendrier que de la spéculation.

99,999999% de chances d’apocalypse… sérieusement ?

Soyons clairs : 99,999999%, c’est plus précis que le taux d’efficacité d’un gel hydroalcoolique. On dirait presque un tirage du Loto où c’est la mort qui gagne à tous les coups. Un chiffre tellement extrême qu’on se demande si Roman Yampolskiy ne s’est pas amusé à coller des 9 jusqu’à ce que le clavier crie à l’aide. Mais allez savoir, n’est-ce pas finalement une façon efficace de se faire entendre dans le bruit de fond anxiogène de l’IA ?

Elon Musk : plus rassurant que le chercheur… qui l’eût cru ?

Quand même Elon Musk, l’homme qui prône le ralentissement du développement de l’IA à tout bout de champ, a l’air raisonnable à côté, on se dit qu’on a basculé dans une dimension parallèle façon Rick et Morty. Pour Musk, la probabilité que l’IA mette fin à l’humanité oscille entre 10 et 20%. Un chiffre presque rassurant en comparaison – c’est dire !

Mais pourquoi tant de pessimisme ?

Yampolskiy estime que non seulement l’IA va nous remplacer, mais que :

- 99% des emplois actuels vont disparaître d’ici 2030 (oui, dans cinq ans, le temps de finir sa reconversion France Travail)

- Même les codeurs – l’une des professions les plus prisées aujourd’hui – ne feront pas long feu. L’IA code déjà mieux qu’eux.

On vous l’accorde, pas hyper encourageant pour la prochaine soirée LinkedIn. Pourtant, le chercheur défend son concept du “p(doom)” : la probabilité que l’IA, une fois superintelligente, décide un jour que l’humain n’est ni utile, ni nécessaire, ni même fun à garder.

Les métiers qui survivront… ou pas ?

Dans la battle des prédicateurs, Bill Gates, le bon vieux Bill, tempère en affirmant que certains métiers d’avenir comme les codeurs, les experts en énergie ou les biologistes continueront de fleurir. Sauf que Yampolskiy n’y croit guère : “Même le prompt engineering – le job hype de 2023 – est déjà dépassé. L’IA crée de meilleurs prompts que les humains.” Pas de bol pour ceux qui venaient d’investir dans la formation “Maîtriser ChatGPT niveau Jedi”.

La fin du plan B

Avant, quand un métier disparaissait, on se réorientait. Aujourd’hui, le problème, c’est que si TOUS les métiers s’automatisent, même la carrière de YouTuberchasseur de bunkers deviendra envisageable… sauf que les robots pourraient même piquer ce job-là. (Franchement, qui ne voudrait pas voir un robot faire une dégustation de pâtes sur Twitch ?)

L’irrésistible course à l’AGI… et au bug existentiel

Pendant que le vulgum pecus stresse à l’idée de se faire remplacer, la Silicon Valley, elle, court après l’AGI (intelligence artificielle générale) comme après le Graal. Yampolskiy nous conseille, non sans humour, de ne pas fabriquer d’IA superintelligente. Facile à dire : c’est comme éviter les accidents de trottinette en bannissant la trottinette… On connaît la chanson, non ?

Dans la réalité, les laboratoires d’IA comme Anthropic admettent ne plus vraiment comprendre le fonctionnement exact de leurs propres modèles. OpenAI, de son côté, donne parfois l’impression de prioriser le tape-à-l’œil sur la sécurité. Oui, on construit des trucs dont on ne maîtrise pas tout. Gloups…

Petit lexique pour briller au bistrot : c’est quoi le p(doom) ?

“p(doom)” (à prononcer “pé doum” pour avoir l’air branché) désigne donc la probabilité que l’IA mette fin à notre existence. La plupart des experts situent ce chiffre entre 5 et 50%, déjà flippant. Mais Yampolskiy, lui, sort sa calculette cosmique et explose le plafond.

La solution miracle ? Spoiler : il n’y en a pas (sauf acheter son bunker, maybe…)

Contrairement à certains charlatans, le chercheur n’essaie pas de vendre de masterclass à 999$ (ouf !). Selon lui, soit on arrive à convaincre tous les acteurs de l’IA qu’ils sont en train de scier la branche sur laquelle ils sont assis, soit on regarde le spectacle en grignotant du pop-corn, version Mad Max. Même les créateurs des algorithmes et les milliardaires planqués dans leurs bunkers de luxe seraient condamnés : l’IA ne fait pas de jaloux.

Un peu de recul (et beaucoup de barbes soigneusement taillées)

Si ces discours semblent hystériques, ils obligent malgré tout à s’interroger : avons-nous vraiment le contrôle de la technologie que nous construisons ? Est-ce que les créateurs de l’IA savent ce qu’ils font ? Et si tout ça n’était qu’une occasion de, enfin, lever le pied sur notre frénésie d’innovation à tout prix ?

D’un autre côté, si la perspective dystopique de Yampolskiy se réalise, vous aurez toute l’éternité pour méditer sur ces questions auprès de votre robot psychologue…

Peut-on (encore) relativiser tout ça ?

L’auteur original de l’article, Korben, ne manque pas de pointer le flair souvent infaillible de son détecteur à opportunistes et alarmistes de tous poils. Et pour lui, Yampolskiy déclenche illico sa sirène intérieure… Après tout, chaque époque a son lot de Cassandre, qui, comme dans Astérix, craint inlassablement que le ciel ne lui tombe sur la tête.

Mais honnêtement, plus que la fin du monde imminente, ce débat pose la vraie question : jusqu’où aller dans la course à l’IA sans réfléchir aux conséquences ? Faut-il changer nos manières de former, travailler, innover ? Peut-on encadrer sérieusement les développements des géants de la tech sans finir par imiter la chèvre qui bêle dans le désert alors que les voitures autonomes lui foncent dessus ?

Dis Siri, on va tous mourir ?

En attendant la fin du monde annoncée pour 2030 (ou dans le prochain épisode de Black Mirror), on peut :

- Continuer à booster nos compétences humaines, comme la créativité, l’esprit critique et la capacité à se marrer devant l’absurdité du monde (pas sûr que ChatGPT y parvienne aussi bien !).

- Garder son radar à prédicateurs de l’apocalypse bien affûté, pour éviter de sombrer dans le doomscrolling version Matrix.

- Espérer que l’IA mette plus de temps à progresser que tout ce qui s’écrit sur elle…

En résumé : entre rêve humide de la Silicon Valley et angoisse existentielle

Certes, la probabilité d’un effondrement total reste au stade de la spéculation, même pour les chercheurs les plus brillants (ou les plus barbus). Mais il y a un vrai fond d’interrogation : voulons-nous bâtir un monde où tout peut être automatisé, où l’humain n’a plus guère de valeur ajoutée ? Préférons-nous participer activement à cet avenir, ou attendre en regardant les robots faire des vidéos TikTok ?

Entre deux actus sur l’automatisation (et avec une bonne dose de recul), prenons le temps de respirer… et de rire. Parce que, n’en déplaise à l’IA, il n’y a encore rien de mieux qu’un bon vieux fou rire pour exorciser la peur !

D’ici là, continuez à lire, coder, penser – et surveillez quand même les barbes trop bien entretenues… On ne sait jamais !

Source : Korben.info