Quand Claude apprend grâce à… vous ?!

L’univers de l’IA n’arrête pas d’évoluer, et aujourd’hui, c’est Claude – le chatbot d’Anthropic – qui défraye la chronique. La nouvelle politique de l’entreprise ? Recueillir vos données d’utilisation pour entraîner encore mieux son intelligence artificielle. À moins, bien sûr, d’avoir le réflexe (de plus en plus nécessaire de nos jours) de refuser explicitement. Alors, à quoi faut-il s’attendre et, surtout, comment garder la main sur vos infos ? Suivez le guide !

Anthropic innove : plus d’intelligence, mais à quel prix ?

Depuis son lancement, Claude s’impose comme l’un des modèles d’IA conversationnelle les plus prometteurs. Mais pour que l’algorithme comprenne mieux nos attentes, Anthropic change son fusil d’épaule. Fini l’apprentissage sur des bases de données publiques lointaines : désormais, la star du traitement du langage puise son inspiration dans vos utilisations quotidiennes.

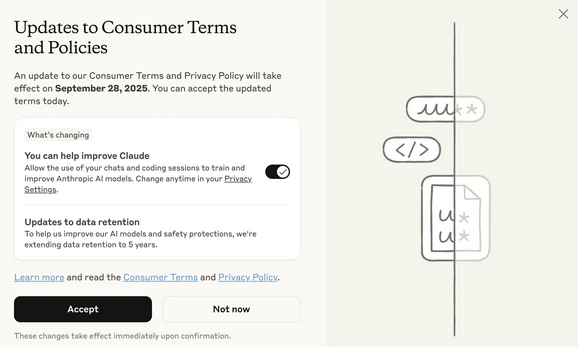

Collecte automatique… ou presque

Un détail qui a son importance : Anthropic collecte les données de ses utilisateurs pour affiner et entraîner Claude par défaut. La petite subtilité ? Pour sortir du lot, il faut choisir l’option de refus explicitement. Autrement dit, si vous ne dites rien, votre prose (même la plus inspirée) ira alimenter les neurones numériques de Claude. Original, n’est-ce pas ?

Pourquoi ce changement majeur ?

Dans la guerre des IA génératives, tout est bon pour obtenir une longueur d’avance : plus de données, c’est plus de pertinence. Les questions, suggestions et corrections venant du réel sont une mine d’or pour comprendre les besoins des utilisateurs… quitte à ce que la frontière vie privée / progrès technologique devienne floue.

Qu’est-ce qui est collecté, au juste ?

Anthropic, fidèle à sa démarche « responsable » (c’est écrit dans la brochure !), se veut rassurant : seules les interactions avec Claude – questions, réponses, feedback, corrections – sont analysées dans un objectif de formation. On nous promet aussi que tout ce qui ressemble à une donnée sensible (identités, numéros de cartes…) doit être évité. Mais convenons-en, qui contrôle vraiment ce que l’IA engrange pendant une session ?

Les messages privés… ne le sont plus vraiment

Même si Anthropic affirme ne pas vouloir exploiter les informations personnelles, il est toujours conseillé de bannir les secrets de famille dans les discussions avec Claude. Mieux vaut garder son code bancaire sous le tapis (et son projet de mot d’esprit sur la pizza à l’ananas dans un coin discret).

Peut-on (vraiment) refuser et comment s’y prendre ?

La collecte automatique vous donne des sueurs froides rien qu’à l’idée ? Pas de panique : Anthropic a prévu une porte de sortie. Pour refuser la collecte de vos interactions, il suffit de modifier vos préférences dans votre compte utilisateur.

Un peu caché, ce bouton « refuser »…

Comme souvent dans le monde du web, l’option n’est pas affichée en lettres clignotantes. Il faut naviguer dans les paramètres du compte sur la plateforme Claude, puis décocher l’option correspondante. Un geste simple, mais qui demande un peu de vigilance, surtout si vous êtes du genre à cliquer sur « Accepter » en moins de temps qu’il n’en faut pour dire « IA ».

Pourquoi ce débat divise ?

Si certains voient dans cette méthode un pas logique pour améliorer la fluidité et la pertinence des IA, d’autres y décèlent une menace grandissante pour la vie privée. Que deviennent ces données après traitement ? Peuvent-elles être anonymisées efficacement ? Seront-elles, un jour, exploitées à d’autres fins… marketing, profilage, voire plus ?

Gare aux mauvaises surprises

L’histoire du numérique ne manque pas d’exemples où des données « d’entraînement » se sont retrouvées utilisées de manière inattendue. La vigilance reste de mise, d’autant que les frontières entre vie privée et business model des IA sont parfois aussi fines qu’une feuille de papier recyclé.

Claude VS la concurrence : nouvelle bataille sur le terrain des données

Anthropic n’est pas la seule à collecter les échanges utilisateur pour optimiser ses IA. OpenAI et Google, pour ne citer qu’eux, adoptent des pratiques similaires. Mais cette logique du « opt-out » (vous êtes inclus sauf si vous dites non) questionne : ne devrait-on pas, par défaut, garantir la confidentialité ?

Le dilemme des utilisateurs

Entre désir de contribuer au progrès (qui n’a jamais rêvé de rendre une IA plus drôle ?) et volonté de rester maître de ses infos, chaque internaute doit trancher. Certains applaudiront la transparence du mécanisme de refus, d’autres regretteront qu’il ne soit pas activé d’office. C’est un peu comme le ketchup sur les frites : tout le monde n’a pas le même réflexe !

Meilleures pratiques : protéger ses données dans l’ère des IA généreuses

Parce que l’avenir appartient à ceux qui sécurisent tôt, quelques astuces pour interagir intelligemment avec Claude (et ses collègues) :

- Vérifiez vos paramètres de confidentialité : Faites un tour régulier dans les entrailles de votre compte pour ajuster vos préférences en matière de collecte.

- Limitez les infos personnelles : Évitez d’entrer des noms, adresses, mots de passe ou toute info sensible dans vos échanges avec les IA. Même si Claude vous semble sympathique, il ne remplacera jamais un coffre-fort !

- Optez pour l’option opt-out si vous tenez à votre confidentialité : Même si cela prend dix secondes, cela peut éviter bien des tracas.

- Restez curieux des évolutions : Les politiques changent vite. Un petit coup d’œil aux mises à jour ne fait jamais de mal… à moins que vous ne soyez allergique aux lignes de texte !

Le panorama IA évolue (et les règles aussi)

Avec Claude, Anthropic s’inscrit dans la tendance actuelle : booster la personnalisation et l’intelligence des agents conversationnels en leur offrant le meilleur des feedbacks humains… c’est-à-dire vous, souvent sans que vous vous en rendiez compte. Ces évolutions témoignent de la soif d’innovation dans le secteur, mais interrogent sur l’équilibre subtil entre facilitation de l’expérience et respect de la vie privée.

Questions ouvertes pour les prochains mois

Anthropic franchit une étape symbolique dans la collecte et l’usage des données utilisateur. D’autres lui emboîteront-ils le pas avec encore moins de garde-fous ? Une législation plus protectrice est-elle à prévoir ? Difficile à dire… mais une chose est certaine : vos échanges avec les IA risquent de devenir eux aussi des données aussi convoitées que la dernière console next-gen un jour de sortie !

Finalement, entre progrès technique et défense de sa confidentialité, chacun devra trouver son juste milieu. Qui l’aurait cru ? Même discuter avec Claude, ce n’est plus aussi anodin qu’un simple chat. Alors, à vous de jouer : données en pâture ou confidentialité en bandoulière ?

Pour lire plus d’articles croustillants sur l’IA et recevoir nos meilleures astuces, restez connectés sur notre site (et promis, on ne collecte rien sans vous prévenir !)