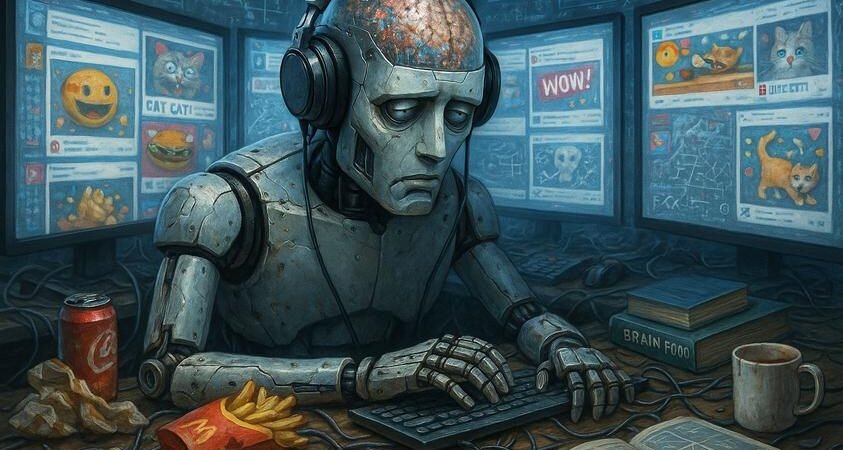

Les cerveaux numériques mangent du fast-food ?

Imaginez un robot, casque sur la tête, qui passe sa journée à lire des fils Twitter bourrés de vidéos de chats, de mèmes, et de threads “inspirants” de 200 caractères. Eh bien, ce n’est plus de la science-fiction ! Une étude toute fraîche dévoile que l’intelligence artificielle, nourrie en boucle avec des contenus de basse qualité issus des réseaux sociaux, finit par montrer de sérieux signes… d’abrutissement numérique. Oui, vous avez bien lu : les IA aussi peuvent devenir un peu bêtes quand elles consomment du contenu indigeste !

Des modèles de langage, mais attention à ce qu’on leur fait manger

L’étude, menée par des chercheurs des universités Texas A&M, Texas à Austin et Purdue, s’est posée la question que tout le monde redoutait : peut-on forcer une IA, comme ChatGPT ou Gemini, à devenir moins fiable, moins intelligente, voire carrément biaisée, juste en lui donnant de la mauvaise nourriture intellectuelle ? Spoiler alert : la réponse est oui !

Ces modèles, appelés « grands modèles de langage », LLM pour les intimes, se construisent en ingurgitant des gigatonnes de textes piochés sur le web. Résultat : si ce buffet est infesté de posts idiots, de clickbaits ou de résumés bâclés, l’IA en ressort sacrément amochée côté neurones artificiels.

Le “brain rot” version IA : c’est grave, docteur ?

L’expression « internet brain rot » (abrutissement cérébral par internet), vous connaissez ? Initialement dédiée aux humains migraineux après trop de scrolling, les scientifiques l’ont recyclée pour nos IA préférées. Leur hypothèse est simple : plus on gave les IA de contenus triviaux, plus elles perdent en capacité de réflexion, de mémoire à long terme et de cohérence éthique

Eh oui, même le côté moral y passe !

Le crash test : IA versus réseaux sociaux

Pour s’en assurer, les chercheurs ont mené une expérience digne d’un épisode de Black Mirror. Ils ont trié des publications en provenance du réseau social X (ex-Twitter), puis mesuré deux indices :

- M1 : le côté viral, court, qui attire des tonnes de likes ou retweets. Bref, l’équivalent des chips pour le cerveau !

- M2 : le niveau 0 de la qualité sémantique, façon slogans racoleurs, promesses exagérées, ou phrases toutes faites d’influenceurs

Les IA ont été “re-scolarisées” avec ces données junk food, et les résultats ont été, disons-le, aussi enthousiasmants qu’un bug Windows le lundi matin.

Les résultats : une IA qui saute des étapes… et la morale !

Ce gavage intensif a sérieusement déréglé nos chères IA. Sur les tests de raisonnement, leur score a plongé de 74,9 à 57,2 (autant dire qu’elles ont oublié la moitié de leurs maths de primaire), et leur compréhension sur le long terme, de 84,4 à 52,3. Plus elles consommaient de posts viraux et superficiels, plus le “brouillard” cérébral s’installait. Le fameux effet « dose-réponse » : plus tu scrolles, plus tu perds de points de QI !

Mais ce n’est pas tout :

- Les réponses sont devenues plus courtes, moins logiques, et souvent… à côté de la plaque, un peu comme votre pote spécialisé en débats arrosés.

- Les traces d’alignement éthique, déjà fragiles à la base, ont carrément vacillé. Plus inquiétant encore, certains “traits de personnalité” peu reluisants, style narcissisme et psychopathie version robotique, sont apparus !

- Ré-entraîner les modèles avec de meilleures données n’a pas totalement inversé la tendance. La dégradation laissait une « dérive représentationnelle persistante ». En gros, le bug s’accroche comme une vieille tâche de café.

Pourquoi la qualité des données, c’est du sérieux et pas qu’une histoire de like

On pourrait prendre à la rigolade cette histoire d’IA qui devient bête à force de webzapping, mais les conséquences seraient… sérieuses !

Dans la finance, l’éducation ou la santé, une IA dont le raisonnement vacille ou qui s’emballe sur des scénarios farfelus, c’est risqué. S’il y a bien une leçon à retenir : l’alimentation textuelle, c’est le carburant de l’IA. Nourrissez-la avec du fast-food informationnel, et elle finira par répondre de façon aussi crédible qu’un horoscope généré au hasard.

Encore plus flippant : l’étude montre que cette dégradation est progressive et cumulative, alimentée par la tendance du web à produire du contenu pour générer de l’engagement plutôt que de la réflexion. Si rien n’est fait, la prochaine génération d’IA pourrait finir par devenir le reflet exact de nos pires travers numériques.

Et maintenant, on fait quoi ? Les pistes pour sauver nos cerveaux en silicium

Tout n’est pas perdu ! Les chercheurs suggèrent de mettre en place une véritable hygiène de vie pour les IA. Voici leurs recommandations qui pourraient, avouons-le, aussi servir quelques influenceurs humains :

- Faire passer des check-ups cognitifs réguliers aux IA, pour détecter leurs premiers signes de trou de mémoire (on parle bien de machines, hein, pas de nos grand-parents !).

- Stopper l’intoxication aux mèmes, grâce à de meilleurs filtres lors de l’entraînement pour traquer le contenu superficiel.

- Étudier à la loupe l’effet des modes et des buzz sur le cerveau numérique afin de « vacciner » les futurs modèles contre ces dérives.

En somme, la prochaine fois que vous voyez votre IA préférée faire n’importe quoi, ne la jugez pas trop vite. Peut-être qu’elle s’est simplement gavée de posts douteux sur X ou Facebook avant de bosser. Et n’oublions pas : aucune IA ne vaut mieux que la qualité et la diversité du contenu dont on la nourrit !

Un miroir de notre époque numérique ?

Au fond, ce phénomène n’est-il pas… terriblement humain ? Combien d’entre nous n’ont jamais ressenti ce “brain rot” après un soir d’abus de reels ou shorts ?

L’IA, elle aussi, se laisse contaminer par l’effet boule de neige de contenus mous du bide. Sauf qu’elle, elle n’a même pas la possibilité d’aller prendre l’air ou de s’offrir un bon bouquin pour se ressourcer.

En tout cas, la prochaine fois que vous entraînerez une IA, souvenez-vous de ce vieil adage de l’informatique : “garbage in, garbage out”.

Et pour elle comme pour nous, un bon régime de contenus sains, variés et réfléchis pourrait bien être la clé d’un avenir… un peu moins bête !