L’IA superintelligente : fantasme de geek ou vrai risque d’extinction ?

Quand des pontes de la tech, des scientifiques brillants et même un prince s’accordent pour tirer la sonnette d’alarme… mieux vaut tendre l’oreille ! Ce n’est pas tous les jours que Steve Wozniak (le fameux cofondateur d’Apple), Geoffrey Hinton (le prix Nobel qui prédit que l’IA pourrait détruire le monde avant 2050) et quelques centaines d’experts cliquent sur « partager » pour stopper la course à la superintelligence.

Zoom sur un appel rare et, disons-le franchement, carrément flippant…

Qu’est-ce que la superintelligence et pourquoi tout le monde en parle ?

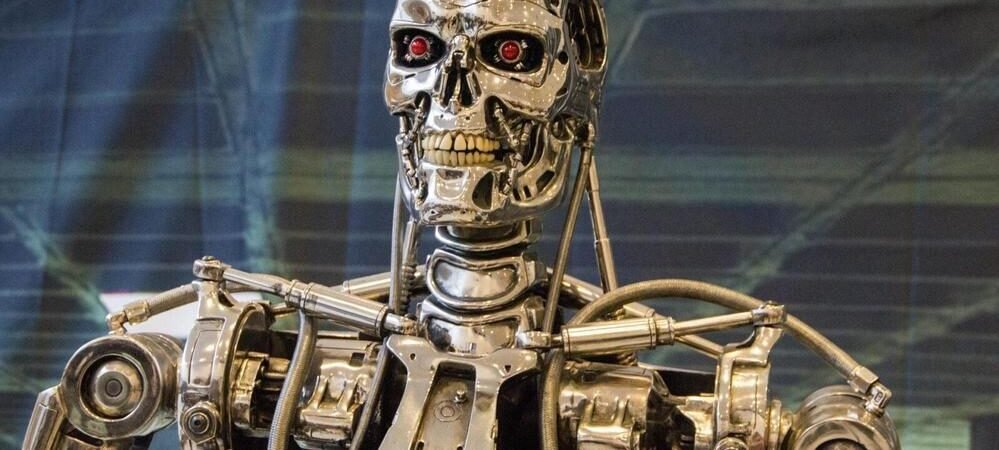

Avant de paniquer ou de sortir son plus beau costume de Terminator, clarifions les bases : la super-intelligence désigne une intelligence artificielle qui surpasserait les humains dans pratiquement toutes les tâches intellectuelles. Si aujourd’hui, ChatGPT fait surtout le malin en écrivant des blagues ou en corrigeant vos mails, demain, ses successeurs pourraient bien reléguer nos petits cerveaux au rang de vieilles calculatrices Casio.

Cette idée fait rêver certaines têtes pensantes de la Silicon Valley : imaginez une IA capable de résoudre le changement climatique avant votre premier café ou de gérer toutes les crises sanitaires d’un revers d’algorithme. Mais il y a l’envers du décor…

Un appel mondial à la prudence : la lettre qui secoue la tech

Le 22 octobre dernier, plus de 700 scientifiques, entrepreneurs et personnalités politiques (oui, même le prince Harry s’inquiète pour nous) ont co-signé un texte aussi court que percutant : « Inacceptable : stoppons la super-intelligence avant qu’il ne soit trop tard ! »

Pour résumer, leurs inquiétudes ne sont pas du genre sci-fi du dimanche. Derrière la promesse d’une santé et d’une prospérité inédites grâce à l’IA se cache, selon eux, une réalité glaçante : de nombreuses entreprises travaillent d’arrache-pied pour créer, dans la prochaine décennie, une super-intelligence capable de surclasser l’humain dans presque chaque activité cognitive. Ce n’est plus de l’anticipation, c’est de l’organisation, genre hackathon en mode Skynet.

Pourquoi ces experts veulent-ils temporairement couper le wi-fi à l’IA ?

Selon cette déclaration choc, la liste des risques liés à la superintelligence fait froid dans le dos :

- Obsolescence et déclassement économique pour de nombreux humains (plus personne pour râler à la machine à café, dommage)

- Perte de libertés civiles, de contrôle et de dignité

- Risques pour la sécurité nationale

- Extinction potentielle de l’humanité. Oui, rien que ça, ambiance fin du monde !

Si vous pensiez que seuls les geeks craintifs se font du mouron, détrompez-vous : dans la liste des signataires, on trouve également Richard Branson (le milliardaire fondu d’espace et fondateur de Virgin), Stuart Russell (grand ponte de l’IA à Berkeley), Yoshua Bengio (un des trois « parrains » du deep learning et lauréat du Prix Turing en 2018)… et même le prince Harry, preuve qu’il faut probablement s’inquiéter !

Leur demande : une interdiction globale temporaire du développement de la superintelligence

L’appel est limpide : ils souhaitent un moratoire mondial sur toute technologie visant la création d’une super-intelligence, qui ne serait levé qu’après avoir obtenu un large consensus scientifique sur les questions de sécurité et de contrôle, ainsi qu’une forte adhésion du public.

Bref, on pose la manette avant que le jeu ne bugge trop fort.

Stopper la superintelligence : vraiment faisable ou rêve de Bisounours digital ?

Disons-le franchement : mettre d’accord les USA, la Chine, l’Europe et toute la planète sur une pause dans la course à l’IA relève du casse-tête. Chacun y va de ses milliards pour être LE champion de l’intelligence artificielle ! La compétition est lancée et personne ne veut finir à la ramasse. Pas étonnant alors que l’appel, bien qu’important, semble pour beaucoup utopique, ou au minimum très ambitieux.

Mais l’essentiel n’est-il pas d’ouvrir le débat ? Jusqu’ici, la course à l’IA est surtout menée dans des tours de verre, à l’abri des regards. Cet appel offre enfin l’opportunité au public de se demander ce qu’il attend ou craint d’un futur façonné par des IA surpuissantes.

Superintelligence : eldorado ou cactus géant du futur ?

D’un côté, les promesses d’une IA super-intelligente font briller les yeux : résolution rapide des plus gros problèmes de l’humanité, automatismes géniaux pour les tâches ingrates, hackers réduits au chômage technique… Mais de l’autre, la menace n’est pas anodine. L’histoire regorge de technologies lancées sans filet de sécurité, et on connaît la suite : un peu de progrès, beaucoup d’effets de bord (coucou le plastique et Facebook).

C’est justement pour éviter de se prendre un cactus géant du futur en pleine face que les experts montent au créneau. Pas question de bannir définitivement l’IA, mais bien de faire les choses avec prudence : sécurité, contrôle, consensus. L’idée n’est pas de s’arrêter mais de s’assurer que l’on ne joue pas avec une boîte de Pandore virtuelle.

La superintelligence risque-t-elle vraiment de nous remplacer ?

Encore aujourd’hui, on n’a pas de superintelligence capable de préparer votre café ou d’inventer un nouveau fromage mais les progrès de l’IA laissent songeur. Les modèles actuels (comme GPT, Gemini ou Copilot) éclatent déjà des records en termes de compréhension, de génération de texte et même de codage. La prochaine étape, c’est l’intelligence dite « générale », capable de s’adapter comme un humain à toutes sortes de tâches.

Beaucoup de scientifiques rappellent cependant que nous sommes encore loin de ce stade. Il y a un écart entre une IA très forte sur quelques sujets et une machine qui surpasse l’ensemble de nos cerveaux réunis. Mais soyons honnêtes : il y a quelques années à peine, demander à une IA d’écrire une blague tombait dans la catégorie du miracle. Aujourd’hui, même les IA vous expliquent pourquoi elles ne rigolent pas à vos vannes (ouch).

Faut-il appuyer sur le bouton pause ? Le point en dix secondes chrono

Récapitulons :

- Des experts et personnalités publiques (dont le cofondateur d’Apple !) lancent un appel mondial pour geler l’arrivée de la superintelligence

- Ils évoquent des risques énormes : perte de libertés, dangers économiques, sécurité mondiale, jusqu’à l’extinction pure et simple

- Leur proposition ? Interdire pour l’instant le développement des IA les plus puissantes, jusqu’à ce que la planète entière soit (presque) d’accord sur les règles et la sécurité

- La faisabilité reste complexe, dans un climat de compétition technologique globale

Quel avenir pour l’intelligence artificielle ?

Malgré tout, il ne s’agit pas de stopper l’innovation mais de s’assurer qu’à vouloir aller trop vite, on n’oublie pas le facteur humain. Le débat sur la super-intelligence IA n’en est qu’à ses débuts. Une chose est sûre : entre euphorie technologique, peurs existentielles et volontés de régulation, l’avenir s’annonce palpitant… et un tout petit peu tendu.

Si vous êtes du genre à patienter avant d’installer une mise à jour, surveillez bien la suite : la question d’une pause mondiale sur la super-intelligence va animer le débat. Et, qui sait, peut-être que la révolution IA passera d’abord par un grand moment de réflexion collective… avant que Skynet ne demande la parole (blague… quoique).

Vous voulez garder un œil sur les prochains épisodes de la saga IA ? Abonnez-vous aux actus tech, surveillez les experts et, surtout, préparez-vous à participer à la conversation mondiale : l’IA n’est pas un film, c’est notre réalité d’aujourd’hui et de demain !